Camera Assisted Pick-By-Feel

Aufgabe

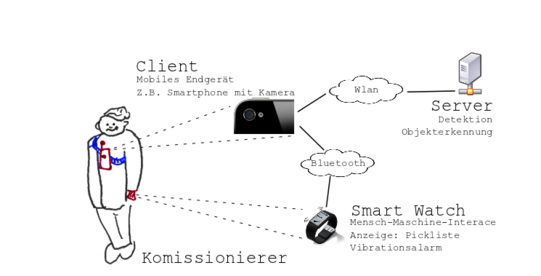

Ziel der Projektgruppe ist es, ein neuartiges informationstechnisches System zur Kommissioniererführung zu entwickeln. Dieses System soll, im Gegensatz zu existierenden Systemen, neben der visuellen Wahrnehmung auch die taktile Wahrnehmung nutzen, um den Kommissionierenden bei seiner Tätigkeit zu unterstützen und gleichzeitig eine möglichst geringe Beeinträchtigung der wichtigen Fernsinne zu erreichen. Die Aufgabe eines Kommissionierenden ist definiert als die Zusammenstellung von Teilmengen von Gütern (Artikel) aus einer Gesamtmenge (Sortiment) auf Grundlage von gegebenen Anforderungen (Aufträge). Dazu erhält er eine sogenannte Pickliste, die Informationen über Lagerorte, Art und Anzahl der zu kommissionierenden Güter enthält. Das zu entwickelnde System hat die Aufgabe, die entnommenen Güter mit der Pickliste abzugleichen und Fehler in der Kommissionierung selbstständig zu erkennen. Im Fehlerfall soll der Kommissionierende über einen Vibrationsalarm benachrichtigt werden. Als Hilfsmittel sollen intelligente Uhren, wie z. B. Pebble oder die Sony SmartWatch, und mobile Kameras (z. B. Handykamera) zum Einsatz kommen. Die Uhren dienen dabei als Mensch-Maschine-Schnittstelle und die Kamera der Überwachung der Arbeitsabläufe. Die Kamera soll die aufgenommenen Bilder an ein Serversystem übermitteln, das die Artikel in der Hand des Kommissionierenden erkennt, mit der aktuellen Pickliste abgleicht und eine Rückmeldung an die Uhr sendet. Die Erkennung der zu kommisionierenden Güter soll mit Hilfe von statistischer Klassifikation erfolgen. Eine Übersicht des durch die Projektgruppe zu entwickelnden Systems ist in Abb. 1 skizziert.

Methodik

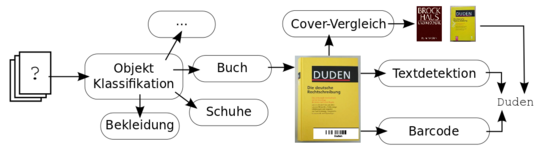

Neben kleineren Aufgaben, wie der Kommunikation zwischen einem Kameraclient und dem Server, sowie der Benachrichtigung des Kommissionierenden im Falle eines Kommissionierfehlers, muss im Rahmen dieser Projektgruppe vor allem ein detaillierter Wissensgewinn über unterschiedlichste Güter mit Hilfe von Kamerabildern erfolgen. Für die Lösung dieses Problems können Methoden aus dem Bereich der Computer Vision und der Mustererkennung angewandt werden. Durch einen modularen Aufbau kann dieser Wissensgewinn, wie in Abb. 2 dargestellt, in mehrere Teilprobleme zerlegt werden.

In einem ersten Schritt sollen Güter in der Hand des Kommissionierenden erkannt werden. Dazu kann beispielsweise die Hand des Kommissionierers mit Hilfe eines Hautfarbenmodells ermittelt werden, sodass ein Rückschluss auf den in der Hand befindlichen Artikel möglich ist. Durch Segmentierung kann, falls notwendig, der Gegenstand vom Hintergrund getrennt werden. Zu diesem Zeitpunkt ist noch kein Wissen über den Artikel in der Hand des Kommissionierenden vorhanden, daher soll anschließend eine grobe Klassifikation erfolgen. In den letzten Jahren haben sich dafür Bag-of-Features-Ansätze als besonders geeignet heraus gestellt. Lokale Bildmerkmale (z. B. SIFT oder HOG) werden aus der Aufnahme des Gutes extrahiert und durch eine Menge von Repräsentanten dargestellt. Je nach Häufigkeit der im Bild vorkommenden Repräsentanten können verschiedene Objektkategorien voneinander unterschieden werden. Um eine solche Unterscheidung zu ermöglichen, ist es notwendig, unterschiedliche Kategorien durch eine Menge von repräsentativen Beispieldaten in einem statistischen Modell abzubilden. Auf diese Weise können beispielsweise Bücher, CDs oder Kleidungsstücke von einander abgegrenzt werden, sodass der Kreis der in Frage kommenden Artikel für die weitere Verarbeitung eingeschränkt wird. In weiteren Schritten muss detailliertes Wissen über den Artikel gesammelt werden. Dazu eignen sich beispielsweise folgende Vorgehensweisen:

- Vergleich von Produktansichten (z. B. Buchcover). Der Vergleich kann als Image-Retrieval-Problem formuliert werden, bei dem, ebenfalls basierend auf einem Bag-of-Features-Ansatz, der ähnlichste Gegenstand aus einer Bilddatenbank ermittelt wird.

- Textdetektion in natürlichen Szenen. Es können beispielsweise Buch- oder CD-Titel oder Produktbeschreibungen auf der Verpackung erkannt werden, um den Artikel zu identifizieren.

- Anstatt des Textes kann der Barcode auf der Verpackung eines Artikels detektiert und identifiziert werden. Dazu kann beispielsweise ein patch-basiertes Verfahren genutzt werden. Anschließend kann über einen Scanline-Algorithmus der Barcode ausgelesen werden.

![[Translate to English:] [Translate to English:]](/storages/zentraler_bilderpool/_processed_/4/b/csm_Ku__nstliche_Intelligenz_Pixabay_7559331fd1.jpg)

![[Translate to English:] [Translate to English:]](/storages/zentraler_bilderpool/_processed_/3/a/csm_Arbeitsplatz-Laptop-Notizbuch_02_ea47030ac6.jpg)

![[Translate to English:] [Translate to English:]](/storages/patrec-cs/_processed_/7/f/csm_lecture_41ff85494b.png)